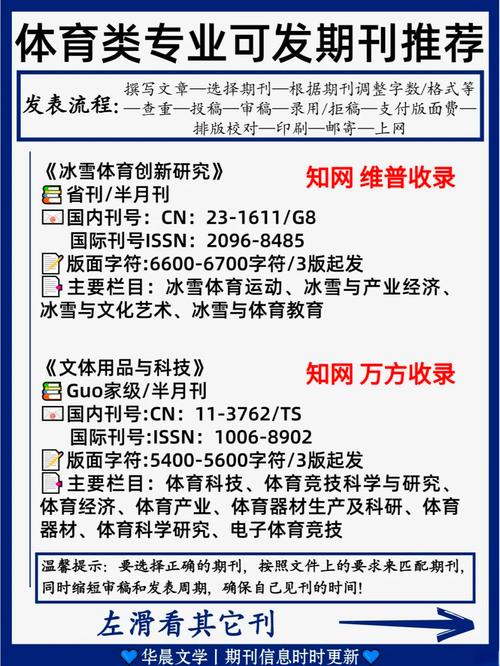

专家谈马斯克质疑中国AI数据造假:数据透明与AI伦理的双重挑战

在当今全球科技竞争日益激烈的背景下,人工智能(AI)作为推动社会进步和产业升级的关键技术,其发展动态一直备受全球瞩目,作为全球科技界的领军人物,埃隆·马斯克(Elon Musk)的言论往往能引发广泛讨论和深思,马斯克对中国的AI数据真实性提出了质疑,这一事件不仅在中国科技界引发了热烈讨论,也在国际上掀起了关于AI数据透明度与伦理的广泛探讨,本文将围绕这一话题,结合专家观点,深入分析马斯克质疑背后的原因、影响以及如何应对数据造假对AI发展的挑战。

一、马斯克质疑的背景与动机

马斯克对AI数据造假的质疑并非空穴来风,其背后反映了全球范围内对AI数据真实性和透明度的普遍担忧,近年来,随着AI技术的快速发展,数据作为其“燃料”的重要性日益凸显,数据的收集、处理和利用过程中存在的诸多问题,如数据来源的合法性、数据质量的可靠性、以及数据使用的伦理性等,都成为了制约AI健康发展的关键因素。

马斯克的质疑主要基于两个方面的考虑:一是中国在AI领域的快速发展可能存在“捷径”,即通过不正当手段获取或篡改数据以提升AI模型的性能;二是担心数据造假会加剧“算法偏见”,导致AI系统在决策过程中出现不公平、不合理的现象,进而影响社会稳定和公共安全。

二、专家观点:数据透明与AI伦理的双重挑战

针对马斯克的质疑,多位专家从不同角度进行了深入剖析,指出了数据透明与AI伦理的双重挑战。

1. 数据透明:构建信任基石

张教授(人工智能伦理学家):数据的透明度是确保AI系统公正、可靠的基础,如果数据本身就存在造假,那么基于这些数据的AI模型无论多么先进,其结果都将是不可信的,建立一套严格的数据审核和公开机制,确保数据的来源、处理过程和结果都能被有效监督和验证,是解决数据造假问题的关键。

2. 算法偏见:避免“技术不公”

李博士(机器学习专家):算法偏见是当前AI领域面临的一大挑战,如果训练数据中存在偏见或歧视性信息,即使是最先进的算法也无法避免这种偏见在模型中的体现,在数据收集阶段就应注重多样性和包容性,确保数据能够真实反映社会的多元面貌,开发能够识别和纠正偏见的算法也是未来研究的重要方向。

3. 法律与监管:制度保障

王律师(科技法律专家):法律和监管是保障数据透明和AI伦理的重要手段,虽然一些国家和地区已经出台了关于数据保护和AI使用的法律法规,但这些法规的覆盖面和执行力度仍有待加强,特别是对于跨国企业和研究机构的数据活动,需要建立更加严格的国际合作机制和监管框架,以防止数据造假和不当使用。

三、应对策略:多维度保障AI健康发展

面对马斯克质疑及由此引发的全球关注,中国及世界各国应采取综合措施,从技术、法律、教育等多个维度保障AI的健康发展。

1. 技术层面:强化数据审核与验证

开发智能化的数据审核工具:利用机器学习和人工智能技术,开发能够自动检测数据异常和篡改的工具,提高数据审核的效率和准确性。

建立数据透明度标准:制定并推广统一的数据透明度标准,要求所有涉及AI训练的数据集都必须公开其来源、处理方法和结果,确保数据的可追溯性和可验证性。

2. 法律与监管层面:完善法律法规与执行机制

制定严格的数据保护法:明确规定数据的收集、处理、使用和共享的规则,加大对数据造假行为的惩罚力度。

建立跨国的监管合作机制:加强国际间在数据保护和AI监管方面的合作,共同打击跨国数据造假行为。

3. 教育与意识提升:培养伦理意识与技术人才

普及AI伦理教育:在高校和研究机构中开设AI伦理相关课程,培养学生的伦理意识和责任感,鼓励企业和研究机构建立内部伦理规范,确保AI技术的研发和应用符合伦理标准。

鼓励技术创新与伦理并重:在科技奖励和资助中加入对伦理贡献的考量,鼓励科研人员在进行技术创新的同时关注其社会影响和伦理风险。

马斯克对中国AI数据造假的质疑虽然引发了争议,但也促使全球科技界和政策制定者更加重视数据的透明度和AI的伦理问题,面对这一挑战,中国及世界各国应携手合作,共同构建一个基于信任、透明和伦理的AI发展环境,通过技术手段保障数据的真实性和可靠性、通过法律手段规范数据的收集和使用、通过教育手段培养具有高度伦理意识的技术人才,我们才能确保AI技术真正服务于人类社会的可持续发展。

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号